Attendue depuis la WWDC 2024, la refonte de Siri s’apprête enfin à débarquer sur iPhone avec iOS 26.4. Après des mois de retard et une remise à plat technique, Apple promet un assistant dopé aux modèles de langage et capable de comprendre le contexte comme jamais auparavant. Calendrier, nouveautés, enjeux stratégiques : voici tout ce qu’il faut savoir sur cette mise à jour clé du printemps 2026.

Une bêta imminente pour une sortie au printemps

Avant de basculer vers iOS 26.4, Apple doit encore déployer iOS 26.3, actuellement en phase Release Candidate. Cette mise à jour intermédiaire, attendue dans les prochains jours, reste relativement modeste. Elle introduit notamment un nouvel outil de transfert entre iOS et Android, étend l’appairage par proximité et permet aux utilisateurs européens de transférer les notifications vers un appareil tiers. Un réglage supplémentaire limite aussi les données de localisation partagées avec l’opérateur sur les modems C1 et C1X.

Mais tous les regards sont déjà tournés vers la suite. Selon Mark Gurman, la première bêta développeurs d’iOS 26.4 serait prévue pour la semaine du 23 février. Une bêta publique pourrait suivre rapidement, avec un lancement final envisagé entre la fin mars et le début avril, un créneau cohérent avec les grandes mises à jour printanières d’Apple.

Signe de l’importance stratégique du chantier, Apple préparerait une communication spécifique autour de cette bêta. Reste à savoir si la firme optera pour un mini événement, une série de démonstrations vidéo ou une présentation plus discrète.

Siri change de cerveau : l’ère des modèles de langage

Présentée initialement lors de la WWDC 2024 dans le cadre d’Apple Intelligence, la nouvelle génération de Siri devait accompagner iOS 18. Le projet a finalement pris près de deux ans de retard. En interne, la tentative de greffer des modèles de langage à l’ancienne architecture de l’assistant aurait échoué, contraignant Apple à repartir sur une base entièrement repensée.

Avec iOS 26.4, Siri adopte enfin un modèle de langage à grande échelle, comparable à ceux utilisés par ChatGPT ou Claude. Concrètement, l’assistant ne se limite plus à identifier des mots-clés pour déclencher des commandes prédéfinies. Il devient capable d’interpréter des requêtes complexes, de gérer des relances et d’intégrer le contexte dans son raisonnement.

Pour accélérer sa transition, Apple a officialisé en janvier un partenariat avec Google. Une version personnalisée de Gemini servira de moteur pour les tâches les plus avancées. Cupertino précise toutefois que le traitement local reste privilégié lorsque cela est possible, et que le Private Cloud Compute prendra le relais pour les opérations nécessitant le cloud, avec des garanties d’anonymisation.

Cette évolution pourrait aussi s’accompagner d’un "moteur de réponses" plus conversationnel, capable de traiter des questions de culture générale dans un style proche des chatbots actuels. L’intégration plus poussée à Spotlight ou Safari serait envisagée, mais pas nécessairement dès cette version.

Contexte personnel, apps et écran : les trois piliers du nouveau Siri

Apple structure cette refonte autour de trois grandes capacités.

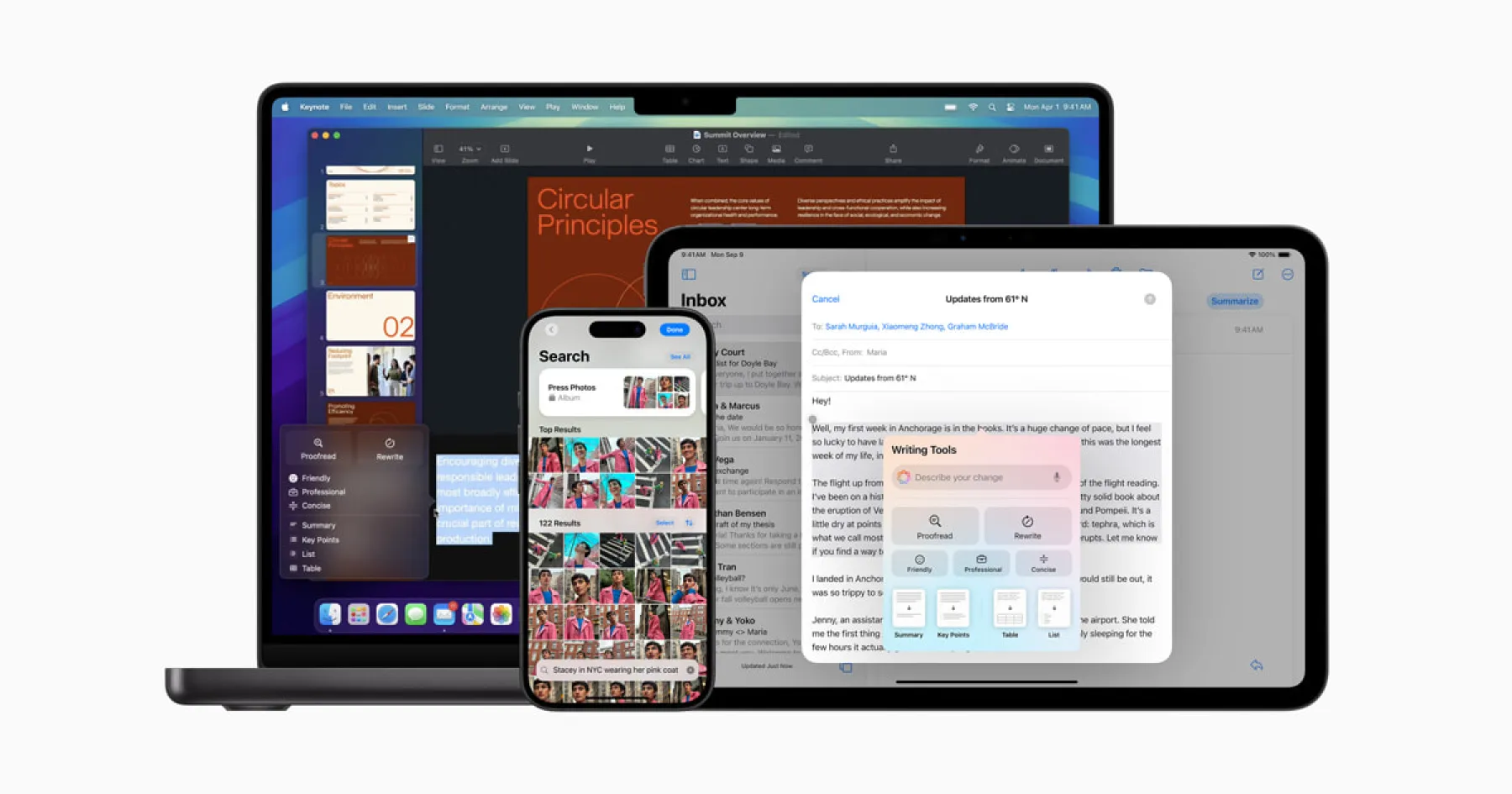

Première brique, le contexte personnel. Siri pourra puiser dans les e-mails, les messages, les photos, les notes ou les événements du calendrier pour répondre à des questions précises. L’objectif est de transformer l’assistant en outil réellement personnalisé, capable d’exploiter les données de l’utilisateur pour fournir des réponses pertinentes.

Deuxième pilier, l’intégration approfondie aux applications. Siri pourra déclencher des fonctions spécifiques au sein d’une app, mais aussi enchaîner des actions entre plusieurs applications. Par exemple, modifier une photo puis l’envoyer à un contact, ou créer un document dans Notes à partir d’informations dictées à la voix.

Troisième avancée majeure, la compréhension de l’écran. L’assistant pourra analyser ce qui est affiché et agir en conséquence, sans que l’utilisateur ait besoin de reformuler le contexte. Une adresse reçue par message pourra ainsi être ajoutée à une fiche contact par simple commande vocale.

À ces nouveautés s’ajouteraient des capacités plus conversationnelles, comme raconter des histoires, répondre à davantage de questions ou accompagner certaines démarches comme une réservation de voyage. Comme souvent avec les versions x.4 d’iOS, de nouveaux emoji validés par le consortium Unicode devraient également faire leur apparition.

Un tournant stratégique pour Apple Intelligence

Au-delà des fonctionnalités, iOS 26.4 représente un moment charnière pour Apple. Siri a longtemps été critiqué pour son retard face à Google Assistant ou aux chatbots d’OpenAI. Cette refonte constitue une tentative claire de repositionner l’assistant au cœur de l’expérience iPhone.

Les nouveautés d’Apple Intelligence devraient aussi être déployées en parallèle sur macOS 26.4 et visionOS 26.4. À plus long terme, la transformation de Siri en véritable chatbot concurrent de ChatGPT est attendue avec iOS 27, potentiellement présenté lors de la WWDC 2026.

Reste une inconnue de taille : le déploiement international. Disponibilité linguistique, lancement en Europe et stabilité des premières versions seront scrutés de près. Après deux ans d’attente et plusieurs ajustements en coulisses, iOS 26.4 s’annonce comme le test grandeur nature du nouveau Siri.